Il video è autentico? Oppure è un falso? Il fatto che non sia sempre facile rispondere a questa domanda è dovuto tra l’altro alle applicazioni di intelligenza artificiale (IA), sempre più raffinate. E con esse si moltiplicano i casi di deepfake. Come smascherarli?

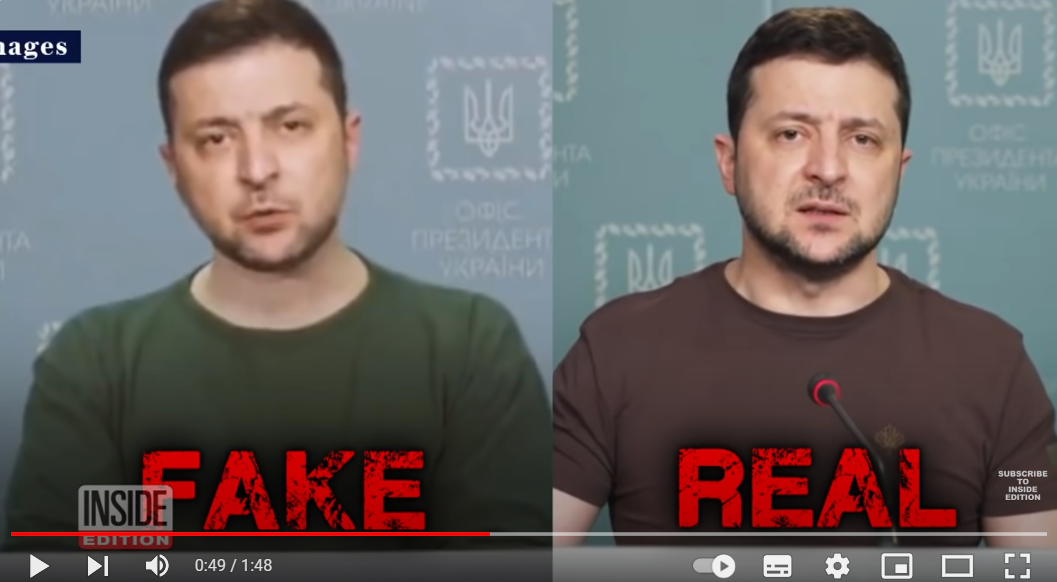

Tra gli esempi più noti e citati vi è quello di → Papa Francesco che compare con un piumino bianco alla moda. Ce n’è un altro in cui il presidente russo → Vladimir Putin s’inginocchia con riverenza davanti al presidente cinese Xi Jinping. O ancora quello di → Donald Trump che viene arrestato. Oppure il video in cui il presidente → Volodymyr Zelensky dichiara la resa in Ucraina.

Tutti questi esempi hanno un denominatore comune: sono stati creati con l’IA. Con l’aiuto di questa tecnologia è possibile ormai manipolare con facilità foto, video e registrazioni vocali. L’attore e regista statunitense Jordan Peele aveva pubblicato già nel 2018 un → video deepfake in cui l’allora presidente statunitense Barack Obama diceva cose che, nel pieno possesso della propria capacità d’intendere e di volere, non avrebbe mai detto in pubblico. Il video dimostra quanto possano sembrare autentiche queste manipolazioni. Senza contare che da allora lo sviluppo non si è arrestato. Gli strumenti di IA continuano a migliorare.

Finora abbiamo dato molta fiducia ai contenuti audiovisivi, perché combinano informazioni sul piano audio e su quello visivo, e per questo li abbiamo sempre ritenuti attendibili.

Patric Raemy, Università di Friburgo